Deepfake AI to technologia, która wykorzystuje sztuczną inteligencję do tworzenia realistycznych, ale fałszywych materiałów wideo i audio. Możesz nie zdawać sobie sprawy, jak łatwo można zmanipulować obraz i dźwięk, co stwarza ryzyko dezinformacji i oszustw. Znaczenie ma znajomość nie tylko technologii, ale również rozwijanie krytycznego myślenia i edukacja społeczeństwa. Czy masz świadomość, jak odróżnić prawdziwe nagranie od jego nieautentycznej kopii?

Czym jest Deepfake i jak działa sztuczna inteligencja?

Deepfake to nowoczesna technologia wykorzystująca sztuczną inteligencję do tworzenia bardzo realistycznych, ale fałszywych treści multimedialnych. Jej działanie opiera się na algorytmach głębokiego uczenia, takich jak sieci GAN i autoenkodery. Sieci GAN, czyli Generative Adversarial Networks, składają się z dwóch części: generatora, który tworzy fałszywe obrazy, i dyskryminatora, który ocenia ich realistyczność. Dzięki temu treści te stają się coraz bardziej podobne do autentycznych. Sztuczna inteligencja, analizując obrazy i dźwięki, może tworzyć cyfrowe kopie ludzi, co pozwala na dowolne manipulowanie mimiką i głosem – taki proces zwany jest impersonacją. Główne zagrożenia wynikające z Deepfake’a to możliwość oszukiwania przez fałszywe nagrania sytuacji, które w rzeczywistości nigdy się nie wydarzyły. Mogą one być używane do szerzenia dezinformacji i dokonywania oszustw, co stanowi zagrożenie dla osób, instytucji i całych społeczeństw.

Rodzaje zagrożeń generowanych przez Deepfake AI

Deepfake znajduje zastosowanie w różnych obszarach, jednak jego wykorzystanie wiąże się z konkretnymi ryzykami. Manipulacja obrazem i głosem może wpływać na procesy informacyjne, bezpieczeństwo finansowe oraz prywatność osób prywatnych i publicznych. Skala zagrożeń zależy od kontekstu użycia technologii oraz podatności odbiorców na cyfrowe manipulacje.

Dezinformacja i propaganda

To poważna kwestia w kontekście dezinformacji i propagandy. Dzięki tej technologii można tworzyć fałszywe materiały audiowizualne, które potrafią destabilizować społeczeństwa, zwłaszcza gdy zmanipulowane treści trafiają do szerokiej publiczności. Na przykład, w fałszywych kampaniach wyborczych i manipulacjach politycznych, specjalnie stworzone nagrania mogą wpływać na wyniki wyborów i decyzje polityczne. To poważne zagrożenie dla demokracji, które podkopuje zaufanie społeczne.

Deepfake wykorzystuje tzw. efekt prawdy iluzoryczne, czyli jeśli powtarzamy fałszywe informacje, mogą one zostać uznane za prawdziwe. Również manipulacja emocjonalna odbiorców wzmacnia przekaz, czyniąc go bardziej wiarygodnym. Ta technologia jest też wykorzystywana często przez nieprzyjazne służby, które chcą destabilizować politykę wewnętrzną w innych krajach.

Zastosowanie Deepfake w dezinformacji ma zasięg globalny i staje się narzędziem w międzynarodowych konfliktach wpływów i wojnach informacyjnych. Dlatego musimy wdrożyć skuteczne metody wykrywania takich manipulacji oraz edukować społeczeństwo, jak rozpoznawać fałszywe materiały.

Oszustwa finansowe i wyłudzenia

Technologia Deepfake jest wykorzystywana w oszustwach finansowych, szczególnie w atakach ukierunkowanych na firmy i instytucje. Manipulacja głosem lub wizerunkiem umożliwia podszywanie się pod kadrę zarządzającą i wydawanie fałszywych poleceń przelewów. Przykładem są sytuacje, w których pracownik działu finansowego otrzymuje telefon od osoby podszywającej się pod prezesa spółki.

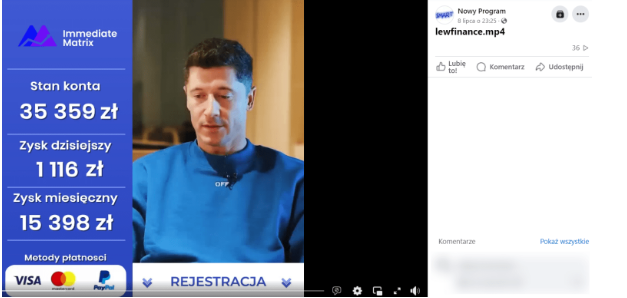

Na podobne nadużycia narażone są również osoby publiczne, których wizerunek bywa wykorzystywany do promowania fałszywych inwestycji lub produktów. Przykładem może być przypadek Roberta Lewandowskiego, którego wizerunek został użyty w spreparowanych materiałach zachęcających do udziału w rzekomych projektach finansowych.

Deepfake zwiększa skuteczność phishingu oraz ataków typu impersonation, ponieważ wzmacnia wiarygodność przekazu. Technologia ta wykorzystywana jest również do tworzenia fałszywych dokumentów tożsamości oraz tzw. wirtualnych porwań, w których przestępcy przedstawiają spreparowane materiały jako dowód zagrożenia.

Naruszenia prywatności i wizerunku

Naruszenia prywatności i wizerunku to poważne zagrożenia, jakie niesie za sobą technologia. Za jej pomocą można tworzyć fałszywe, intymne materiały, które poważnie godzą w prywatność i reputację ofiar. Ofiary mogą przez to odczuwać ogromny stres psychiczny i stać się obiektem stygmatyzacji w społeczeństwie. Często skutkuje to utratą reputacji zawodowej i osobistej, a także problemami w pracy oraz życiu towarzyskim. W przypadku zagrożeń, jakie niesie Deepfake, szczególną uwagę należy zwrócić na następujące aspekty:

- bywa używany do sextortion, czyli szantażu seksualnego,

- ofiary są zastraszane ujawnieniem sfabrykowanych materiałów w zamian za korzyści finansowe lub inne,

- technicznie zaawansowane oszustwa często łączą się z cyberprzemocą,

- osoby publiczne są w szczególnym niebezpieczeństwie, ponieważ są bardziej widoczne i wpływowe.

Jednym z najtrudniejszych aspektów tej technologii jest to, że trwałe uszkodzenie wizerunku może przez nią pozostać w sieci na zawsze, co oznacza długotrwałe konsekwencje dla poszkodowanych.

Jak rozpoznać Deepfake?

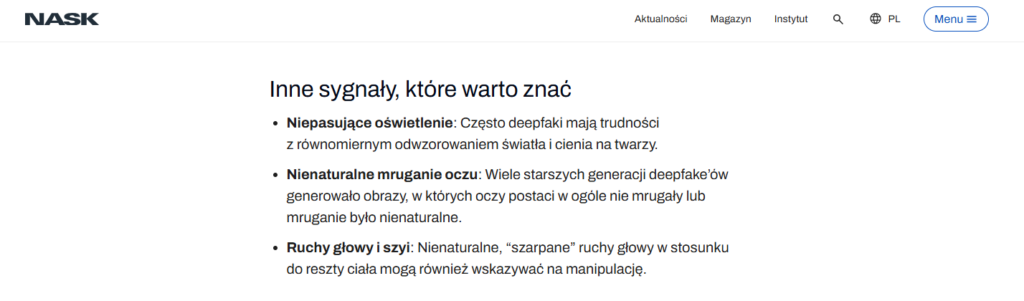

Rozpoznanie bywa trudne, ponieważ materiały generowane przez AI coraz lepiej imitują naturalne zachowania człowieka. Są jednak powtarzalne sygnały, które mogą wskazywać na manipulację:

- nienaturalna mimika twarzy,

- zaburzona synchronizacja ruchu ust z dźwiękiem,

- nieregularne lub nienaturalnie rzadkie mruganie,

- niespójności w oświetleniu między twarzą a tłem,

- artefakty wizualne, takie jak rozmycia lub nienaturalny odcień skóry,

- zniekształcona modulacja głosu,

- niepłynne wypowiedzi.

Takie anomalie wynikają z ograniczeń modeli generatywnych, szczególnie w obszarze odwzorowania detali biometrycznych i synchronizacji warstwy audio-wideo. Równolegle rozwijane są narzędzia analityczne oparte na sztucznej inteligencji, które identyfikują mikronieprawidłowości niewidoczne dla odbiorcy. Skuteczna ocena autentyczności materiału wymaga jednak zestawienia go z innymi źródłami oraz uwzględnienia kontekstu publikacji.

Ochrona przed Deepfake – technologie, regulacje prawne i świadome nawyki cyfrowe

Ochrona przed nadużyciami technologii Deepfake wymaga podejścia systemowego, łączącego rozwiązania technologiczne, regulacyjne i organizacyjne. Obejmuje rozwój narzędzi detekcyjnych analizujących treści syntetyczne, ram prawnych określających odpowiedzialność za ich rozpowszechnianie oraz rozwijanie kompetencji cyfrowych użytkowników i instytucji. Skuteczność tych działań zależy od skali zagrożenia i kontekstu wykorzystania materiału.

Narzędzia wykrywania i weryfikacji autentyczności materiałów

Weryfikacja materiałów generowanych przez Deepfake opiera się na analizie obrazu, dźwięku oraz danych zapisanych w strukturze pliku. Systemy detekcyjne wykorzystują modele sztucznej inteligencji do identyfikowania artefaktów generatywnych, niespójności w synchronizacji warstwy audio-wideo oraz mikronieprawidłowości w mimice twarzy.

Równolegle rozwijane są rozwiązania oparte na kryptografii, które pozwalają potwierdzić integralność materiału od momentu jego powstania. Przykładem jest projekt ProvenView rozwijany przez IDEAS NCBR. Wykorzystuje on technikę Zero-Knowledge Proof (ZKP), umożliwiającą potwierdzenie autentyczności wideo bez ujawniania jego treści ani danych źródłowych. Twórca nagrania generuje cyfrowy dowód pochodzenia, który odbiorca może zweryfikować, sprawdzając, czy materiał nie został zmodyfikowany.

Analiza może obejmować również mikroekspresje twarzy, nieregularności kompresji czy anomalie w strukturze pikseli. Warto przy tym zaznaczyć, że ProvenView pozostaje w fazie prototypowej, co pokazuje, że kryptograficzne potwierdzanie autentyczności treści nie stanowi jeszcze powszechnie wdrożonego standardu.

Edukacja, procedury i budowanie odporności organizacyjnej

Budowanie odporności na nadużycia technologii Deepfake nie sprowadza się wyłącznie do narzędzi analitycznych. Duże znaczenie ma poziom świadomości osób pracujących z informacją oraz sposób, w jaki organizacja reaguje na podejrzane treści. Rozumienie mechanizmów manipulacji ułatwia wychwycenie sytuacji, w których materiał może być syntetyczny lub celowo zniekształcony. Oznacza to wprowadzanie jasnych zasad postępowania w przypadku incydentów informacyjnych. Monitoring treści, dodatkowa weryfikacja komunikatów czy określone ścieżki decyzyjne w sytuacjach kryzysowych pozwalają ograniczyć skutki potencjalnych nadużyć.

Znaczenie ma również kontekst regulacyjny. Przepisy dotyczące tworzenia i rozpowszechniania szkodliwych materiałów syntetycznych porządkują odpowiedzialność i ułatwiają reagowanie na nadużycia. Połączenie kompetencji cyfrowych, procedur organizacyjnych oraz ram prawnych wzmacnia odporność na manipulację informacyjną, na jaką pozwala to narzędzie.

- Czym jest Deepfake i jak działa sztuczna inteligencja?

- Rodzaje zagrożeń generowanych przez Deepfake AI

- Dezinformacja i propaganda

- Oszustwa finansowe i wyłudzenia

- Naruszenia prywatności i wizerunku

- Jak rozpoznać Deepfake?

- Ochrona przed Deepfake – technologie, regulacje prawne i świadome nawyki cyfrowe

- Narzędzia wykrywania i weryfikacji autentyczności materiałów

- Edukacja, procedury i budowanie odporności organizacyjnej